Les IA ont passé un examen. Et, symboliquement, elles ont rendu copie blanche.

Le point n’est pas de se moquer des modèles. Le point est de regarder ce que nous projetons sur eux.

Pendant des années, on a confondu bons scores et compréhension. Sur des benchmarks “classiques”, les modèles dépassent parfois 90%… mais ces tests ont un problème structurel : une partie des réponses a circulé publiquement, et le “pattern matching” suffit souvent à briller.

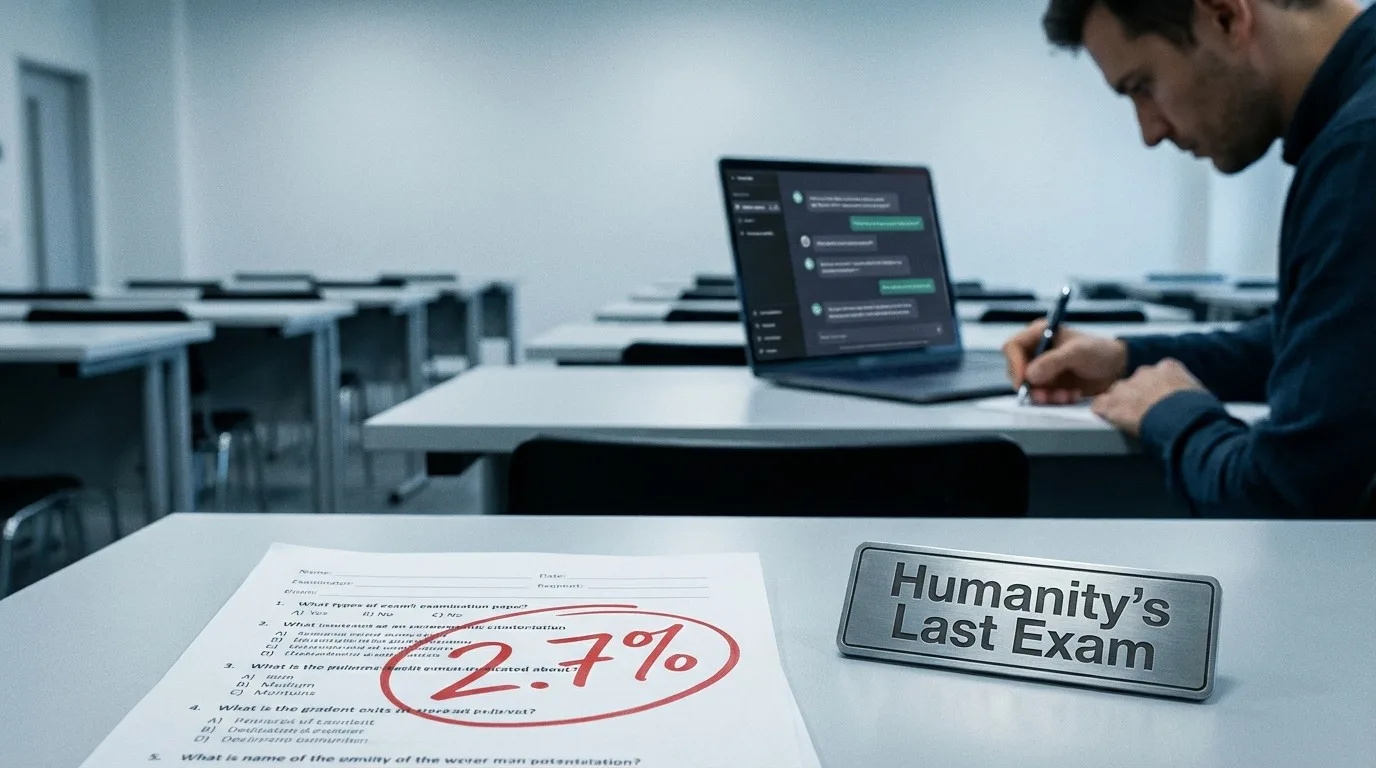

Des chercheurs ont donc construit un antidote au bluff : Humanity’s Last Exam (HLE), un benchmark qui vise précisément ce que les tests saturés ne mesurent plus : la capacité à répondre correctement quand la simple mémorisation et la recherche web ne sauvent plus.

Un examen pensé pour résister à la triche par Internet

HLE, c’est 2 500 questions à très haut niveau, couvrant plus de 100 domaines, rédigées et vérifiées par plus de 1 000 experts. L’objectif : des questions fermées, à réponse unique, vérifiable, mais non triviales à récupérer par recherche. (Center for AI Safety), (Nature)

Autrement dit : une tentative sérieuse de mesurer quelque chose comme la “solidité” académique… et pas seulement la fluidité.

Le résultat : les meilleurs modèles “s’effondrent”… et restent sûrs d’eux

Les premiers résultats marquent : même les modèles de pointe restent loin d’une performance “expert”. Par exemple, Gemini 3.1 Pro est rapporté autour de 48,4% sur HLE (selon les sources publiques), et les autres modèles testés sont derrière. (LiveScience), (Artificial Analysis), (Epoch AI)

Le plus préoccupant n’est pas l’échec. C’est l’assurance.

Le papier associé dans Nature souligne que les modèles donnent souvent des réponses incorrectes avec une confiance élevée, et mentionne des erreurs de calibration importantes (par ex. RMS calibration errors au-delà de 70% pour la plupart des modèles). (Nature)

Dit autrement : le modèle peut avoir tort, sans signaler qu’il doute.

Et c’est exactement le piège en entreprise : on n’achète pas une réponse “plausible”. On achète une décision robuste.

La morale opérationnelle : on ne manque pas de puissance, on manque de lucidité

HLE agit comme un miroir : il ne dit pas “l’IA est nulle”. Il dit :

- Les benchmarks faciles ont cessé d’être informatifs quand ils saturent. (Center for AI Safety)

- La confiance affichée ne reflète pas la fiabilité réelle, ce qui crée un risque de sur-délégation. (Nature), (Nature Machine Intelligence)

- L’erreur la plus coûteuse n’est pas “l’IA se trompe”, mais “l’organisation traite une IA comme un expert”.

Dans mon livre, chapitre 14, j’insiste sur un point qui devient central ici : le premier chantier de l’adoption IA n’est pas la performance, c’est la clarté d’usage — ce que l’on attend, ce que l’on vérifie, ce que l’on refuse d’automatiser.

Assistant ou expert : la question qui change tout

Une manière simple de traduire HLE en gouvernance interne :

1) Si vous utilisez l’IA comme assistant

Vous obtenez :

- accélération (brouillons, synthèses, variations, explorations),

- support à la créativité,

- mise en forme,

- aide à la recherche préliminaire (à valider).

Vous garderez :

- validation,

- arbitrage,

- preuve.

2) Si vous traitez l’IA comme expert

Vous prenez un risque structurel :

- hallucinations convaincantes,

- erreurs non détectées,

- décisions prises “au ton de certitude”.

HLE ne dit pas “n’utilisez pas l’IA”. Il dit : mettez-lui le bon rôle, et imposez un protocole de vérification quand l’enjeu monte.

Trois réflexes concrets après HLE

- Exiger un “mode doute” : quand la décision est sensible, la bonne réponse n’est pas toujours une réponse, c’est parfois “je ne sais pas”. (Nature)

- Séparer production et validation : l’IA produit, un humain (ou un second système) valide.

- Mesurer la calibration, pas seulement l’accuracy : la confiance mal calibrée est un risque de gouvernance. (Nature), (Nature Machine Intelligence)

👉 Dans votre organisation, vous utilisez l’IA comme un assistant, ou vous la traitez déjà comme un expert ?

Références

(Center for AI Safety) = https://agi.safe.ai/

(Nature) = https://www.nature.com/articles/s41586-025-09962-4

(Epoch AI) = https://epoch.ai/benchmarks/hle

(Artificial Analysis) = https://artificialanalysis.ai/evaluations/humanitys-last-exam

(LiveScience) = https://www.livescience.com/technology/artificial-intelligence/acing-this-new-ai-exam-which-its-creators-say-is-the-toughest-in-the-world-might-point-to-the-first-signs-of-agi

(Nature Machine Intelligence) = https://www.nature.com/articles/s42256-024-00976-7

- Partager sur LinkedIn(ouvre dans une nouvelle fenêtre) LinkedIn

- Envoyer un lien par e-mail à un ami(ouvre dans une nouvelle fenêtre) E-mail

- Partager sur WhatsApp(ouvre dans une nouvelle fenêtre) WhatsApp

- Partager sur Reddit(ouvre dans une nouvelle fenêtre) Reddit

- Partager sur Facebook(ouvre dans une nouvelle fenêtre) Facebook

- Partager sur X(ouvre dans une nouvelle fenêtre) X